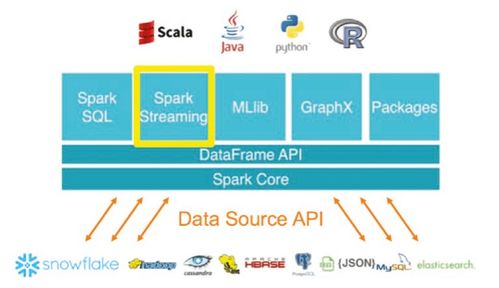

在當(dāng)今數(shù)據(jù)驅(qū)動的時代,實時數(shù)據(jù)處理能力已成為企業(yè)獲取競爭優(yōu)勢的關(guān)鍵。Apache Spark,作為一個統(tǒng)一的分析引擎,憑借其卓越的流數(shù)據(jù)處理模塊——Spark Streaming(以及其進化版Structured Streaming),為構(gòu)建低延遲、高吞吐、高容錯的實時數(shù)據(jù)處理應(yīng)用提供了強大的解決方案。

一、Spark流數(shù)據(jù)處理的核心概念

Spark流數(shù)據(jù)處理并非傳統(tǒng)的逐條記錄處理,而是采用一種被稱為“微批處理(Micro-batch)”的模型。它將連續(xù)的實時數(shù)據(jù)流,按時間間隔(如1秒、2秒)切分成一系列小的、確定性的批處理作業(yè)(即RDD或DataFrame),然后利用Spark核心引擎強大的批處理能力對這些小批次數(shù)據(jù)進行快速計算。這種設(shè)計巧妙地在流處理的實時性和批處理的可靠性、易用性之間取得了平衡。

Structured Streaming 在此基礎(chǔ)上更進一步,它將無限增長的實時數(shù)據(jù)流視為一張持續(xù)追加的表,用戶可以使用熟悉的Dataset/DataFrame API進行查詢。這種聲明式的API將開發(fā)者從復(fù)雜的容錯、狀態(tài)管理細節(jié)中解放出來,專注于業(yè)務(wù)邏輯。

二、數(shù)據(jù)處理的關(guān)鍵環(huán)節(jié)與技術(shù)

一個完整的Spark流數(shù)據(jù)處理管道通常包含以下幾個核心環(huán)節(jié):

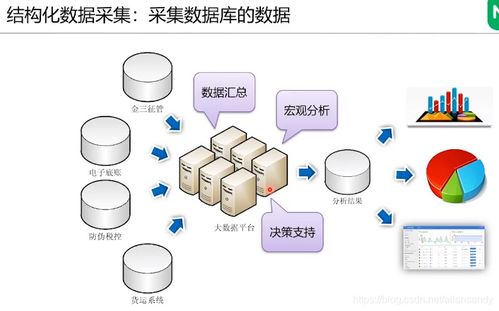

- 數(shù)據(jù)接入(Ingestion):Spark Streaming可以從多種實時數(shù)據(jù)源接入數(shù)據(jù),如Kafka、Flume、Kinesis,以及TCP Socket等。與Kafka的集成尤為緊密和高效,是生產(chǎn)環(huán)境中最常見的組合。

- 核心轉(zhuǎn)換與計算(Transformation & Computation):這是數(shù)據(jù)處理的“大腦”。開發(fā)者可以利用豐富的轉(zhuǎn)換操作(如

map、filter、join、groupBy)和窗口操作(滑動窗口、滾動窗口)對數(shù)據(jù)進行清洗、聚合、關(guān)聯(lián)等復(fù)雜計算。例如,可以計算最近5分鐘內(nèi)某商品的點擊量,或者將實時用戶行為日志與靜態(tài)用戶畫像表進行關(guān)聯(lián)分析。

- 狀態(tài)管理(State Management):對于需要跨批次追蹤信息的應(yīng)用(如用戶會話分析、累加計數(shù)),Structured Streaming提供了內(nèi)置的、容錯的狀態(tài)管理機制(如

mapGroupsWithState、flatMapGroupsWithState),確保即使發(fā)生故障,狀態(tài)也能精確恢復(fù)。

- 結(jié)果輸出(Sink):處理后的結(jié)果可以輸出到多種外部系統(tǒng),包括文件系統(tǒng)(如HDFS、S3)、數(shù)據(jù)庫(如MySQL、Cassandra)、消息隊列(如Kafka)以及控制臺,以供下游系統(tǒng)使用、可視化或持久化存儲。

- 容錯與一致性(Fault Tolerance & Exactly-Once Semantics):這是生產(chǎn)系統(tǒng)的生命線。Spark通過預(yù)寫日志(Write-Ahead Log)和檢查點(Checkpointing)機制,結(jié)合可靠的數(shù)據(jù)源和輸出端,能夠?qū)崿F(xiàn)端到端的“精確一次”處理語義,確保數(shù)據(jù)既不丟失也不重復(fù)。

三、典型應(yīng)用場景

- 實時監(jiān)控與告警:實時分析服務(wù)器日志、應(yīng)用性能指標(APM),及時發(fā)現(xiàn)異常并觸發(fā)告警。

- 實時推薦系統(tǒng):根據(jù)用戶實時點擊、瀏覽行為,即時更新用戶興趣模型,調(diào)整推薦結(jié)果。

- 金融風(fēng)控:實時監(jiān)控交易流水,利用規(guī)則或模型在毫秒級內(nèi)識別欺詐行為。

- 物聯(lián)網(wǎng)(IoT)數(shù)據(jù)處理:處理海量傳感器上傳的時序數(shù)據(jù),進行實時聚合、分析與預(yù)測性維護。

- 實時儀表盤:為運營人員提供實時更新的業(yè)務(wù)關(guān)鍵指標(KPI)視圖。

四、挑戰(zhàn)與最佳實踐

盡管Spark流處理功能強大,但在實際應(yīng)用中仍需注意:

- 延遲與吞吐量的權(quán)衡:更小的批處理間隔帶來更低延遲,但會增加調(diào)度開銷,可能影響吞吐。需要根據(jù)業(yè)務(wù)需求調(diào)整。

- 資源規(guī)劃:流處理作業(yè)是7x24小時長時運行的服務(wù),需要合理分配Executor內(nèi)存、核心數(shù),并設(shè)置動態(tài)資源分配以提高集群利用率。

- 背壓(Backpressure)處理:當(dāng)數(shù)據(jù)流入速度超過處理速度時,系統(tǒng)需具備動態(tài)調(diào)整接收速率的能力,Spark Streaming通過反壓機制來自動調(diào)節(jié)。

- 監(jiān)控與運維:需密切監(jiān)控批處理時間、調(diào)度延遲、積壓批次等關(guān)鍵指標,確保作業(yè)穩(wěn)定運行。

###

Apache Spark的流數(shù)據(jù)處理框架,特別是Structured Streaming,通過將流計算抽象為對無限表的增量查詢,極大地簡化了實時應(yīng)用的開發(fā)復(fù)雜度。它結(jié)合了批處理的強大功能和流處理的實時性,為處理高速增長的數(shù)據(jù)流提供了一個統(tǒng)一、可擴展且高可靠的一站式平臺。掌握Spark流數(shù)據(jù)處理,意味著能夠駕馭數(shù)據(jù)的“流速”,從實時數(shù)據(jù)中即時提煉價值,驅(qū)動業(yè)務(wù)快速智能決策。